Uma conta do TikTok chamada de @deeptomcruise começou a postar videoclipes do ator de Hollywood Tom Cruise fazendo de tudo, desde jogar golfe , viajar e contar uma piada no que parece ser uma loja de roupas masculinas na Itália, até realizar um truque de mágica com uma moeda.

Em cada um dos três vídeos, Cruise dá sua risada maníaca como aquela que ele soltou no vídeo maluco de recrutamento da Cientologia anos atrás. Quando olhamos os vídeos, parece exatamente como Cruise, só que não é Cruise.

O Tom Cruise do @deeptomcruise (cuja conta agora é de acesso privado), parece ser muito mais jovem do que o ator americano de 58 anos, e muitos centímetros mais alto (o verdadeiro Cruise tem 1,65m). Além disso, sua voz é diferente, mas mesmo assim, o falso Cruise do TikTok conseguiu confundir e horrorizar várias pessoas.

Como escreveu a fotógrafa Lauren White: “Falsificações profundas estão ficando assustadoras e dominando o TikTok. Cada figura pública deve ter uma conta verificada, mesmo que não queira criar conteúdo, para facilitar a identificação de suas falsificações.”

O @deeptomcruise é um “deepfakes”, um termo que combina “deep learning” e “fake” que o MIT Sloan descreve como “um tipo específico de mídia sintética em que uma pessoa em uma imagem ou vídeo é trocada pela imagem de outra pessoa”. É bastante alarmante que até mesmo um falso Cruise esteja ganhando popularidade no TikTok, o destino de mídia social escolhido pela Geração Z.

O que é mais engraçado é que o falso Cruise é mais bonito que o verdadeiro Cruise. A conta @deeptomcruise tem mais de 220 mil seguidores e continua aumentando.

O MIT Sloan forneceu a seguinte descrição de como alguém cria um “deepfake”:

“Para fazer um vídeo deepfake, um criador troca o rosto de uma pessoa e substitui-o por outro, usando um algoritmo de reconhecimento facial e uma rede de computador de aprendizagem profunda chamada de autocodificador variacional [VAE]. VAEs são treinados para codificar imagens em representações de baixa dimensão e, em seguida, decodificar essas representações de volta em imagens.

Por exemplo, se você quisesse transformar qualquer vídeo em um deepfake com a estrela de cinema ganhadora do Oscar Nicolas Cage, você precisaria de dois codificadores automáticos – um treinado em imagens do rosto do ator e outro treinado em imagens de uma ampla diversidade de rostos.”

“As imagens de rostos usadas para ambos os conjuntos de treinamento podem ser selecionadas aplicando um algoritmo de reconhecimento facial a quadros de vídeo para capturar diferentes poses e condições de iluminação que ocorrem naturalmente. Uma vez feito esse treinamento, você combina o codificador treinado nas diversas faces com o decodificador treinado nos rostos de Nicolas Cage, resultando no rosto do ator no corpo de outra pessoa.”

Essa tecnologia surgiu no Reddit em 2017 e resultou em uma série de clipes de notícias virais falsos promovidos por seguidores trolls do Presidente Trump. Em agosto de 2019, um vídeo deepfake se tornou viral de Bill Hader lentamente se transformando em Tom Cruise durante uma aparição de David Letterman em 2008.

Seu criador, um artista 3D eslovaco conhecido por “Tom”, disse ao The Guardian que ele fez cerca de vinte vídeos deepfake usando um programa de código aberto, com cada um levando de 3 a 5 dias para criar.

“É uma corrida armamentista: alguém está criando deepfakes, outra pessoa está trabalhando em outras tecnologias que podem detectar deepfakes”, disse Tom. “Eu realmente não vejo isso como o fim do mundo como a maioria das pessoas vê.” Será mesmo?

O que um super computador de IA e muito dinheiro não poderia fazer com essa tecnologia? E se o presidente de um país, por algum motivo obscuro, fosse substituído por um ator utilizando a tecnologia deepfake?

O uso desse tipo de tecnologia está se acelerando. Talvez como parte da histeria do coronavírus, com as pessoas forçadas a ficarem separadas umas das outras e vivendo em um mundo virtual, os manipuladores estão usando a oportunidade para confundir ainda mais os limites entre a realidade e o mundo virtual.

Afinal, uma convenção virtual pode provavelmente se tornar uma presidência virtual. O vídeo onde Hunter Biden, o filho problemático de Joe Biden, “falou” na Convenção “Virtual” do Partido Democrata, é um exemplo do uso de deepfake.

A principal pergunta é: Por que eles fizeram isso? A resposta mais óbvia é que o verdadeiro Hunter Biden provavelmente estava muito bêbado ou muito drogado para realmente se sentar e filmar. Por que se preocupar com o verdadeiro Hunter (um idiota elitista drogado) quando você tem a tecnologia para apenas fingir?

Alguns usuários de mídia social perceberam que aquele não era Hunter. O vídeo do discurso, com link abaixo, é a “pièce de résistance”. É uma farsa óbvia. Dê uma olhada, o vídeo felizmente é curto. Se fizeram um deepfake de Hunter, porque não fariam o mesmo com o demente Joe Biden?

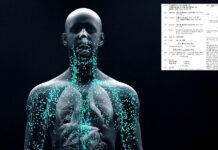

Você acha que é bom em localizar vídeos falsos, onde pessoas famosas dizem coisas que nunca disseram na vida real? Veja como eles são feitos nesta palestra surpreendente e demonstração de tecnologia. O cientista da computação Supasorn Suwajanakorn mostra como ele usou IA e modelagem 3D para criar vídeos falsos fotorrealistas de pessoas sincronizadas com áudio.

A inteligência artificial foi usada para modelar precisamente as expressões faciais de Obama e o movimento da boca quando ele fala. Sua técnica permite que eles coloquem qualquer palavra na boca sintética de Barack Obama. A palestra abaixo tem legenda em português.